1. Einleitung

A/B-Tests sind eines der wichtigsten, vielleicht sogar das wichtigste, Werkzeug zur Conversion-Optimierung. Es gibt jedoch zwei Einschränkungen:

- Nicht für alle Unternehmen sind A/B-Tests sinnvoll.

- Für Unternehmen, wo A/B-Tests sinnvoll sind, sind zurzeit noch nicht alle Voraussetzungen hierfür erfüllt.

Diese Checkliste beschreibt alle diese Voraussetzungen:

- sinnvolle und messbare Ziele (2. Kapitel)

- eine grundoptimierte Website (3. Kapitel)

- eine ausreichende Anzahl an Conversions (4. Kapitel)

- ein korrekt implementiertes Testing-Tool (5. Kapitel)

- Zugriff auf Ressourcen in der Webentwicklung und im Webdesign (6. Kapitel)

- Unterstützung durch Vorgesetzte (7. Kapitel)

2. Sinnvolle und messbare Ziele

A/B-Tests versuchen eine bestimmte Metrik zu verbessern. Nur wenn die Verbesserung der Metrik auch zum Unternehmenserfolg beiträgt, sind A/B-Tests sinnvoll. Diese Metriken müssen außerdem messbar sein.

Die Anzahl der Verkäufe und der Umsatz tragen offensichtlich zum Unternehmenserfolg in Online-Shops bei. Einfach zu messen sind sie auch. Sie eignen sich also als Ziele. Ziele wie Klicks auf den „In den Warenkorb“-Button sind dagegen weniger sinnvoll. In den Warenkorb gelegte Produkte werden schließlich nicht immer auch gekauft.

Für Landingpages sind Verkäufe von Produkten oder Abschlüsse von Verträgen sinnvolle und messbare Ziele. Auch gesammelte Leads per Kontaktformular oder Telefon sind sinnvoll. Für letztere ist etwas mehr Aufwand notwendig, messbar sind Aufrufe jedoch trotzdem.

Andere Ziele sind zwar einfach zu messen, jedoch für den Unternehmenserfolg irrelevant. Dazu gehören unter anderem:

- Engagement

- Aufenthaltsdauer / Verweildauer

- Anzahl der Seitenaufrufe

Wenn dies die einzigen für A/B-Tests verwendbare Metriken sind, suchen Sie nach anderen Metriken oder priorisieren das Projekt A/B-Testing nach hinten.

3. Grundoptimierte Website

A/B-Tests machen gute Websites besser; sie bringen Website von gut zu sehr gut. Falls Sie also eine suboptimale Website, Online-Shop oder Landingpage verwenden, verbessern Sie diese zuerst anhand von Best Practices und Heuristiken. Danach führen Sie A/B-Tests durch.

Natürlich können suboptimale Websites auch per A/B-Test verbessert werden und so hohe Steigerungen der Conversion-Rate eingefahren werden. Die Umsetzung von Tests benötigt jedoch immer wertvolle Ressourcen, insbesondere dann, wenn größere Änderungen getestet werden. Falls offensichtlich ist, dass die aktuelle Website Probleme aufweist, beheben Sie diese Probleme zuerst und testen dann.

Bei ConversionBoosting finden Sie alle Ressourcen für diese Verbesserungen:

4. Ausreichende Anzahl Conversions

Fast allen Mitarbeitern und Verantwortlichen im Online-Marketing ist mittlerweile klar, dass für A/B-Tests eine Mindestanzahl an Conversions benötigt wird. Die nächste Frage lautet entsprechend häufig „Wie viele Conversions werden denn für sinnvolles Testen benötigt?“

Mit 500 Conversions/Monat kann sicherlich schon sinnvoll getestet werden. [1]

Eine feste Antwort wie diese versperrt aber den Weg zum Verständnis, wovon es wirklich abhängt, wie viele Conversions notwendig sind. Diese Antwort ist für jede Website verschieden und abhängig davon, wie groß das Potenzial zur Steigerung der Conversion-Rate ist:

- Bei der Auswertung von A/B-Tests kommen sogenannte Hypothesentests zum Einsatz. Sie überprüfen, ob die Ergebnisse zufällig zustande kamen oder die Testvariante tatsächlich einen Einfluss auf die Conversion-Rate hat.

- Diese Hypothesentests betrachten den Unterschied zwischen den Conversion-Rates der Testvarianten und der Kontrollvariante. Ist dieser Unterschied groß genug, ist es wahrscheinlich, dass ein Ergebnis nicht zufällig zustande kam.

- Je einfacher Testvarianten also zu einer Steigerung der Conversion-Rate führen, desto weniger Conversions werden benötigt, um statistisch signifikante Ergebnisse zu erzielen. Im Umkehrschluss bedeutet dies, dass wenn das Besucherverhalten schwieriger zu beeinflussen ist, mehr Conversions vorhanden sein müssen.

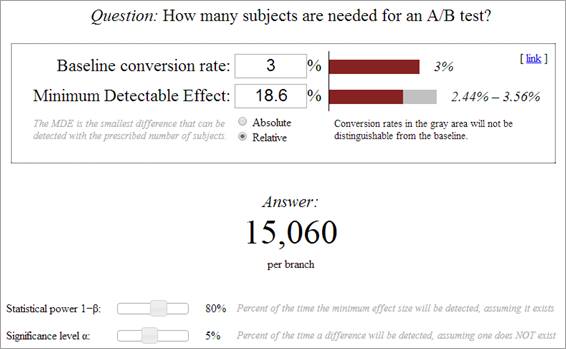

Was bedeutet dies nun konkret in Zahlen? Ein Beispiel:

- Es soll eine Testvariante (plus Kontrollvariante) getestet werden.

- Es gibt 30.000 Besucher/Monat.

- Die aktuelle Conversion-Rate beträgt 3 % und es gibt somit 900 Conversions/Monat.

Wenn eine Steigerung von 18,6 % erreicht wird, dann beträgt die statistische Signifikanz 95 %. Das heißt, wenn in diesem Fall mindestens eine Steigerung von 18,6 % erzielt wird, reichen durchschnittlich 900 Conversions/Monat aus, um – in einem Monat – ein statistisch signifikantes Ergebnis zu erzielen.

Wenn dagegen nur eine Steigerung von 13,1 % erreicht wird, dann muss der Test zwei Monate laufen.

Diese Zahlen können zum Beispiel mithilfe des Sample Size Calculator von Evan Miller individuell errechnet werden:

Die Vorgehensweise:

- Geben Sie unter „Baseline conversion rate“ die Conversion-Rate der zu testenden Seite(n) ein.

- Geben Sie unter „Minimum Detectable Effect“ die angenommene Steigerung der Conversion-Rate ein und wählen „Relative“ aus.

- Das Tool zeigt dann die Anzahl der benötigten Testteilnehmer, um diese Steigerung mit der Wahrscheinlichkeit von 95 % (100 – Significance level α 5 %) zu erkennen.

- Verändern Sie die Steigerung der Conversion-Rate, um zu sehen, wie viele Testteilnehmer benötigt werden, um diese zu erkennen.

5. Korrekt implementiertes Testing-Tool

Um Tests erfolgreich durchzuführen, muss ein professionelles Testing-Tool eingesetzt und korrekt implementiert werden. Eine ausführlichere Anleitung und Hinweise auf verschiedene Herausforderungen und Fallstricke finden Sie in der Checkliste „Testing-Tool implementieren“.

Hier eine Zusammenfassung der wichtigsten Punkte:

- Das JavaScript-Tag ist im Quelltext direkt nach dem -Tag eingebaut.

- Den Warenkorbwert/Umsatz wird auf der Vielen-Dank-Seite übergeben.

- Das Testing-Tool ist mit der Webanalyse-Software integriert.

6. Zugriff auf Ressourcen in der Webentwicklung und im Webdesign

Fast keine Testvariante kommt ohne grafische Gestaltung aus. Um ansprechende Layouts zu testen, benötigen Sie deshalb professionelle Webdesigner.

Ähnliches gilt für die Programmierung von Testvarianten. Einige Tests lassen sich mithilfe der Point-and-Click-Editoren der Testing-Tools umsetzten. [2] Für andere benötigen Sie jedoch Zugriff auf Ressourcen in der Webentwicklung mit JavaScript – entweder intern oder durch Freelancer/Agenturen.

Klären Sie intern, auf welche Ressourcen Sie zurückgreifen können. Idealerweise gibt es einen Webdesigner und einen Webentwickler, die (zumindest in Teilzeit) alle Anfragen für A/B-Tests abarbeiten.

Bauen Sie sich einen langfristigen Pool an Freelancern auf, um personelle Engpässe im Unternehmen zu vermeiden. Dieser Prozess dauert einige Zeit. Fangen Sie also rechtzeitig an und vergeben kleinere Projekte extern, um erste Erfahrungen zu sammeln.

7. Unterstützung durch Vorgesetzte

Sie werden im Laufe der Durchführung von A/B-Tests viele Hindernisse überwinden müssen. Hierzu gehören unter anderem

- Freigaben von Testvarianten: Erhalten Sie die Erlaubnis, dass auch größere und/oder riskantere Varianten getestet werden können?

- Abstimmung mit IT: Die Zusammenarbeit zwischen Marketing und IT ist oft schwierig, da die Abteilungen unterschiedliche Ziele verfolgen. Die Unterstützung von Vorgesetzten kann hier Prioritäten in der IT anders setzen.

- Zugriff auf Ressourcen in Webdesign und Webentwicklung (siehe voriges Kapitel): Der Einsatz von Vorgesetzten hilft, interne Ressourcen zugesprochen zu bekommen.

Wenn Vorgesetzten von der Notwendigkeit von A/B-Tests überzeugt sind und sich für diese begeistern können, dann werden Sie diese bei der Überwindung dieser und anderer Hindernisse unterstützen.

Einige Ideen, wie Sie sich die Unterstützung von Vorgesetzten sichern können:

- Rechnen Sie Vorgesetzten vor, wie viel zusätzlichen Umsatz über ein Jahr lang das Unternehmen bei einer Steigerung der Conversion-Rate von nur 5 % machen würde.

- Zeigen Sie, dass Ihre Konkurrenz auch testet und dass Sie diesen Nachteil ausgleichen sollten.

- Falls Ihre Konkurrenten noch keine Conversion-Optimierung betreibt, können Sie als early adopter schnell einen Wettbewerbsvorteil erreichen.

- Wenn ein Tool zur Session-Wiedergabe im Einsatz ist, [3] zeigen Sie Vorgesetzte, mit welchen Problemen Besucher auf der Website kämpfen. Solch eine visuelle Präsentation ist oft überzeugender als bloße Zahlen.

[1] Falls weniger Conversions gemessen werden, kümmern Sie sich erst darum, mehr Traffic zu beschaffen und setzen auf qualitative Methoden wie Remote-Usability-Tests.